它不是简单的AI对话小工具,而是把大模型深度嵌入Burp,支持本地模型、云端AI,甚至能让Claude这类AI直接接管扫描、分析、挖洞。

你只需要做高价值手动测试,剩下的重复劳动,全部丢给AI。

一、它到底强在哪?硬核能力一览

1. 支持9种AI后端,本地云端随便玩

不管你想用本地大模型,还是直接调用云端API,它全都支持:

-

Ollama

-

LM Studio

-

NVIDIA NIM

-

通用OpenAI兼容接口

-

Gemini CLI / Claude CLI / Codex CLI / OpenCode CLI / Copilot CLI

不想泄露数据?直接本地跑Ollama的llama3.1,完全离线可用。

2. 53+ MCP工具:Claude直接“驾驶”Burp

开启MCP服务后,Claude Desktop可以直接调用Burp能力:

-

读取代理历史

-

发送测试请求

-

执行被动/主动扫描

-

自动识别IDOR、注入、越权

-

自动创建漏洞报告

你只需要说一句:“帮我扫一下History里的IDOR漏洞”,它就能全自动跑完一整套流程。

3. 双引擎AI扫描,覆盖62类漏洞

-

被动AI扫描:不发请求,只流量分析

-

主动AI扫描:带200+Payload,自动发包测试

支持注入、身份认证、加密缺陷、文件包含、XSS、SSRF、IDOR等62种漏洞类型。

4. 三重隐私模式,企业合规放心用

-

STRICT 严格模式:自动抹除Cookie、Token、敏感数据

-

BALANCED 平衡模式:部分脱敏

-

OFF 关闭:完整发送数据

所有交互日志以JSONL存储,带SHA256哈希,可审计、可追溯。

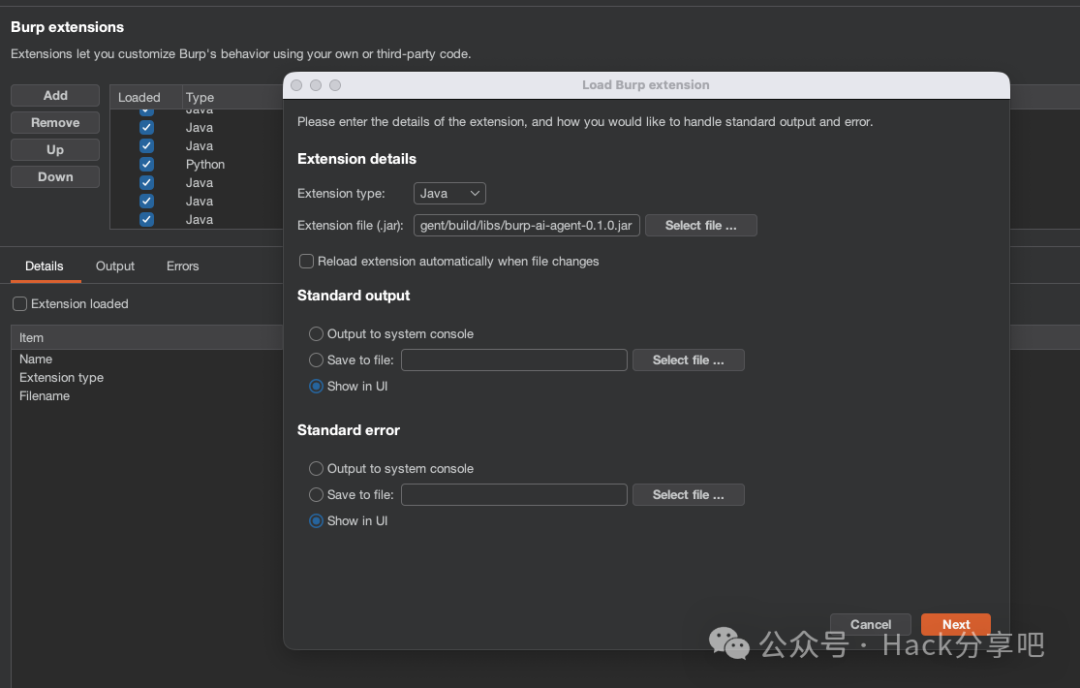

二、2步安装,开箱即用

1. 下载或编译Jar

去GitHub Releases下Jar,或源码编译(需要Java 21):

git clone https://github.com/six2dez/burp-ai-agent.gitcd burp-ai-agentJAVA_HOME=/path/to/jdk-21 ./gradlew clean shadowJar

build/libs/xxx.jar2. 载入Burp

Extensions → Installed → Add → Java,选中Jar,加载成功后顶部出现 AI Agent 标签。

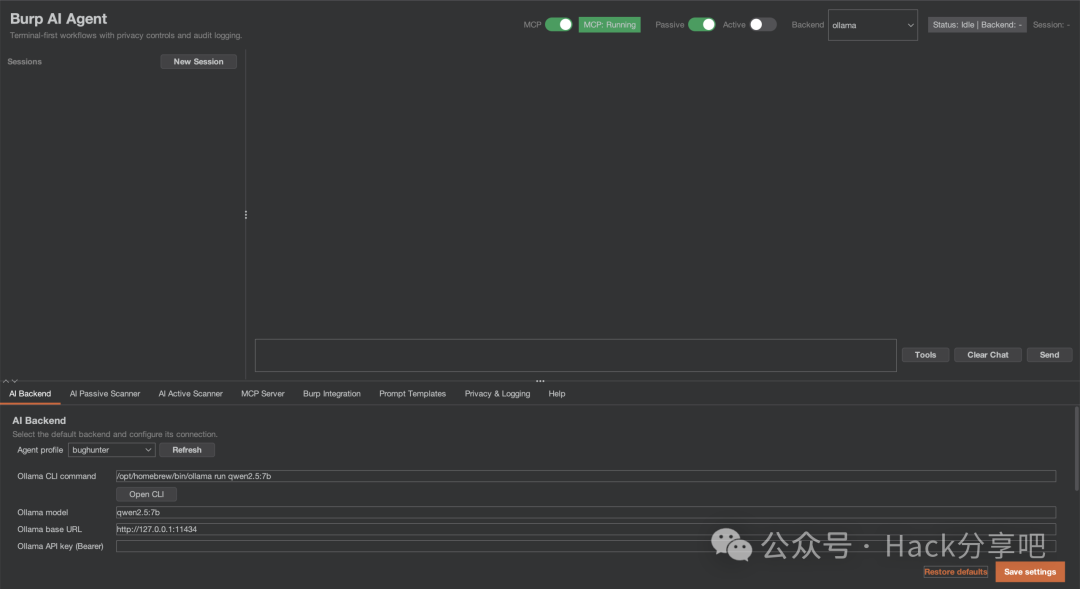

三、1分钟配置AI后端(推荐Ollama)

-

装Ollama,跑起来:

ollama serve -

拉模型:

ollama pull llama3.1 -

Burp AI Agent → Settings

-

Backend 选 Ollama

-

URL:

http://127.0.0.1:11434 -

Model 填

llama3.1

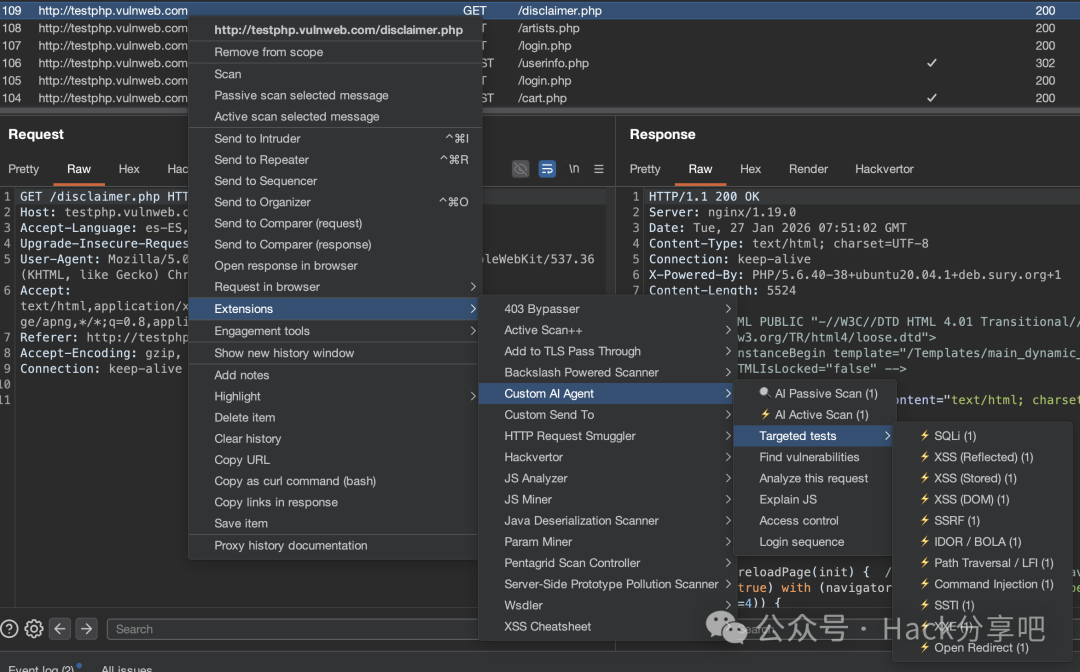

四、最简单用法:右键一键AI分析

-

Burp代理抓包

-

进入 Proxy → HTTP history

-

选中一条请求 → 右键

-

Extensions → Burp AI Agent → Analyze this request

AI会直接给出:

-

漏洞风险点

-

参数可能存在的问题

-

业务逻辑隐患

-

修复建议

不用你再一条条猜漏洞。

五、高阶玩法:让Claude全自动扫Burp

-

设置里开启 MCP Server

-

编辑Claude配置文件:

Mac:

~/Library/Application Support/Claude/claude_desktop_config.jsonWin:

%APPDATA%\Claude\claude_desktop_config.json加入配置:

{"mcpServers": {"burp-ai-agent": {"command": "npx","args": ["-y","supergateway","--sse","http://127.0.0.1:9876/sse"]}}}

六、隐藏神器:Burp Scan Skill

项目里自带一个 burp-scan 技能,丢给Claude Code、Gemini CLI:

-

自动理解Burp MCP

-

自动做被动+主动扫描

-

自动生成漏洞单

-

支持IDOR、SQLi、RCE、LFI、XXE等

你只需要写自然语言,AI帮你打完所有Payload。

七、适合谁?注意什么

适合人群

-

天天做Web渗透、漏洞挖掘的安全工程师

-

不想手动看流量的红队

-

想本地离线AI分析的人

-

企业需要合规、脱敏、可审计扫描

注意点

-

AI不能100%替代人工,仍需复核

-

云端AI注意数据合规,尽量开STRICT隐私模式

-

初次配置稍微有点麻烦,跟着文档走一遍就会

seo优化_前端开发_渗透技术

seo优化_前端开发_渗透技术